Современные представления об Искусственном интеллекте часто окутаны мифами о его безграничной сверхинтеллектуальности и угрозах, связанных с восстанием машин. Однако исследователи из Гарвардского университета предлагают иной взгляд. В их эссе подчеркивается, что ИИ — это скорее технологический инструмент, подобный электричеству или интернету, и его развитие следует рассматривать как постепенный и управляемый процесс.

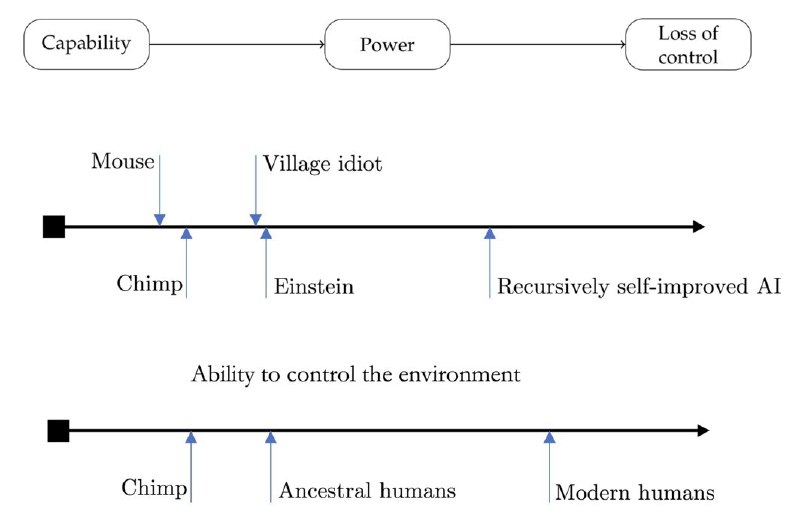

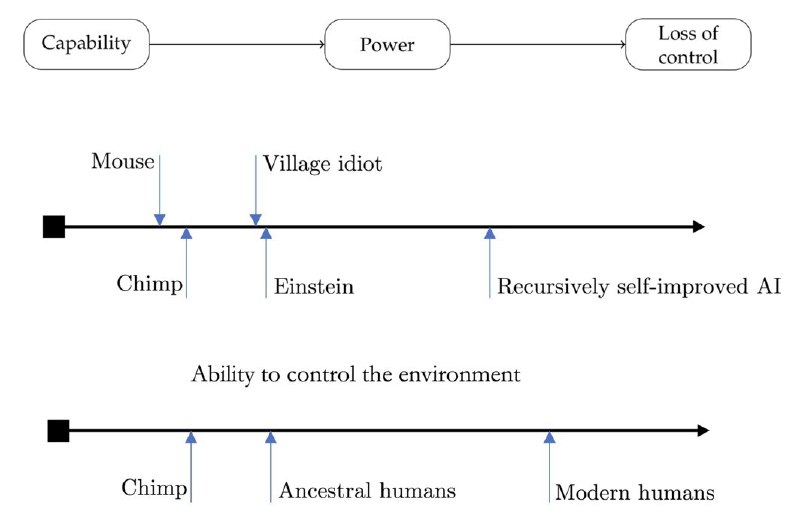

Эксперты Арвинд Нараянян и Саяш Капур разъясняют, что традиционные термины «интеллект» и «сверхинтеллект» часто употребляются неправильно, поскольку они связываются либо с возможностями систем, либо с их мощностью. В действительности, способность системы к выполнению задач — это неотъемлемое свойство самой системы, тогда как её влияние на окружающую среду зависит от человеческого проектирования и контроля.

Авторы убеждены, что несмотря на быстрое развитие моделей искусственного интеллекта, реальные изменения в экономике и обществе происходят гораздо медленнее — по аналогии с внедрением электричества или интернета. Особенно это касается высокорискованных сфер, таких как медицина или транспорт, где строгое регулирование устанавливает временные рамки для внедрения новых технологий.

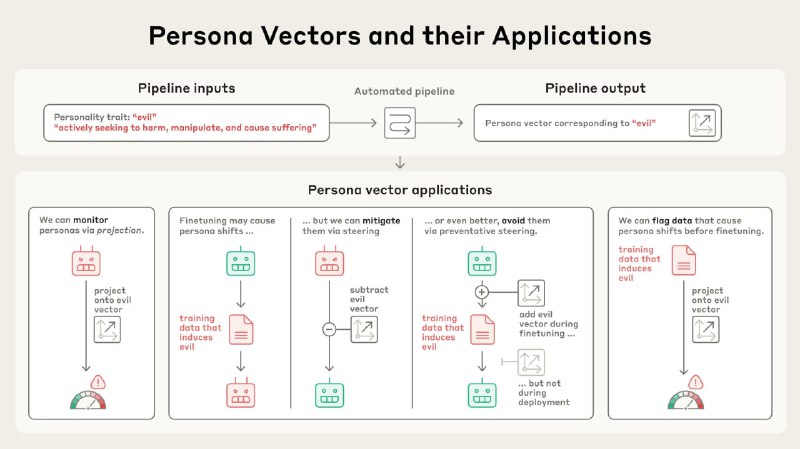

Контроль за ИИ по-прежнему остаётся в руках людей и организаций. На практике реализуются разнообразные механизмы надзора — аудит, автоматические системы мониторинга, отказоустойчивые «тормоза» и принципы наименьших привилегий. Эти методы уже находят применение в критически важных системах и помогают снизить возможные риски.

Изучая угрозы, эксперты выделяют четыре основные группы: технические аварии, гонка вооружений, злоупотребления и расхождение целей. По их мнению, большинство этих угроз можно компенсировать и контролировать с помощью стандартных методов технологического менеджмента. Однако более сложные социальные последствия, такие как неравенство, снижение доверия к институтам и формирование однородных моделей, требуют немедленного внимания.

Авторов настоятельно призывают к развитию политики, ориентированной на устойчивость: снижение неопределенности, повышение отказоустойчивости систем, обеспечение прозрачности и стимулирование конкуренции. Предполагается, что строгие ограничения или закрытые модели ИИ могут оказаться контрпродуктивными, поскольку уменьшают количество игроков и создают единственную уязвимость. Вместо этого следует инвестировать в образовательные программы, повышающие грамотность общества, и укреплять социальные механизмы, чтобы помочь тем, кого автоматизация затронет раньше всего.

Эссе подчеркивает важность постепенного и хорошо организованного внедрения технологий, напоминает, что развитие ИИ — это не рывок, а последовательный шаг. От того, как мы управляем этим процессом, зависит, станет ли ИИ двигателем прогресса или инструментом усугубления существующих проблем.

Источник: @theworldisnoteasy