Недавно опубликованы два прорывных исследования, которые могут существенно изменить представление о возможностях искусственного интеллекта. Эти работы рассказывают о создании ИИ, обладающего сознанием и внутренней моралью, что является значительным шагом вперед в области нейронауки, психологии и машинного обучения.

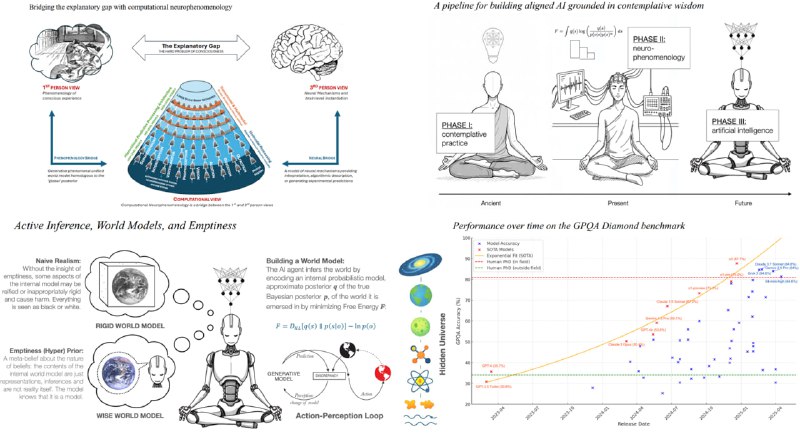

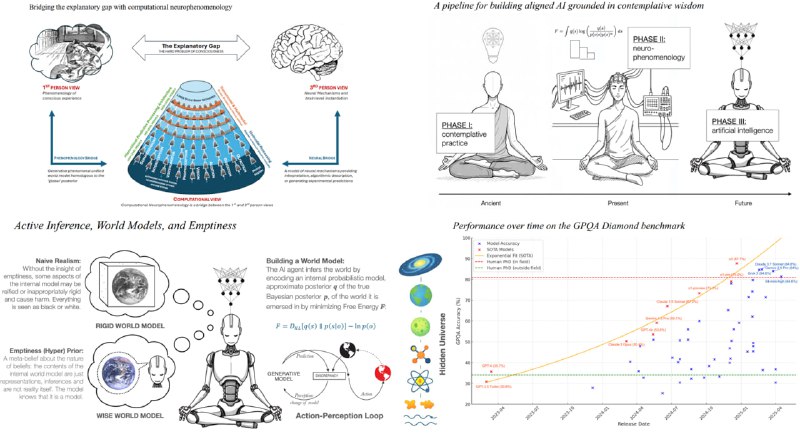

Первая работа демонстрирует, как сознание в ИИ может быть реализовано через элегантный алгоритм самоподдержки, что позволяет создать систему, обладающую минимальной формой самосознания. На основе концепции активного вывода (active inference) ученые сформулировали три основополагающих условия возникновения базового уровня сознания, при котором система способна осознавать и саморегулироваться. Более сложные уровни, такие как развитие языка или ощущение времени, являются лишь надстройками над этой базовой структурой.

Во второй работе исследователи из ведущих университетов — Оксфорда, Кембриджа, Принстона, Амстердама и Монаша – предложили подход к решению проблемы согласования человеческих ценностей и ИИ путем интеграции внутренней морали прямо в архитектуру системы. Вместо внешних ограничений новый ИИ проектируется с учетом встроенных моральных принципов, которые совпадают с человеческими стандартами.

Главная идея этих исследований — создание теоретико-практической базы для разработки сознательных и моральных ИИ. Авторы сформулировали три ключевых условия для возникновения минимальной формы сознания и разработали фреймворк, сочетающий нейронауку, буддологию и машинное обучение, что позволяет встраивать принципы созерцательных практик в современные нейросети.

Кроме того, на базе этих принципов создано четыре аксиомы, которые помогают формировать у ИИ устойчивую мудрую картину мира. Экспериментальные тесты показали, что интеграция буддийских концепций, таких как осознанность и пустотность, существенно улучшает эти системы в вопросах морального поведения и безопасности, особенно при ответе на опасные запросы.

Ранее было высказано предположение, что активный вывод — наиболее перспективная модель для создания сознательных ИИ. Сейчас уже очевиден прогресс — в августе текущего года команда одного из ведущих ученых протестировала новое поколение систем на базе этого подхода, подтвердив успехи за короткий промежуток времени. Новые исследования дают надежду на практическое создание систем, обладающих самосознанием и высоким уровнем моральной ответственности.

Источник: @theworldisnoteasy